ディープフェイク動画の衝撃、AIで作られる「高品質なデマ」

このニュースをシェア

【2月10日 AFP】もし、ある政治家が普段は絶対しそうにない発言をしたり、ハリウッドのスター女優が、あり得ないB級アダルトビデオに出演したりする映像を目にしたら、あなたは映像機器の問題を疑うかもしれない──。しかし、未来の「フェイクニュース」は、実はそのようなものになるのではとの考えがある。

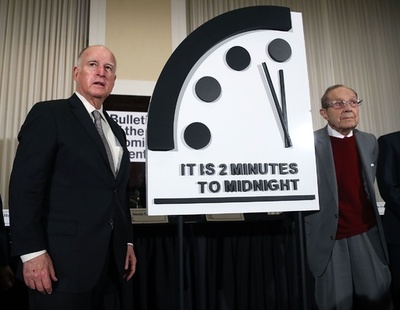

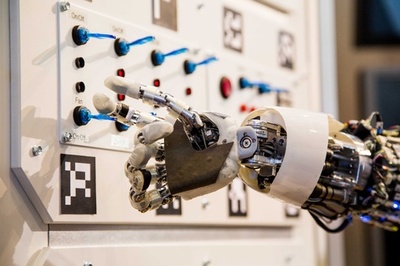

近年の人工知能(AI)の進化で、実際の映像を巧みに加工する「ディープフェイク」動画のクオリティーは、より精巧になっている。そして、その影響から、新たな種類のデマや虚報が破滅的な結果をもたらす危険性も同様に高まりつつあるのだ。

「しっかりとした筋書きのディープフェイクをタイミング良く広めることができれば、選挙結果を覆したり、暴動寸前の都市で混乱生じさせたりすることが可能になる。また、敵対する相手の残虐行為を主張する反政府派の声を強化したり、社会の政治的分断を悪化させたりすることもできるだろう」

米シンクタンク「外交問題評議会(Council on Foreign Relations)」のブログでそう警告するのは、米テキサス大学(University of Texas)のロバート・チェスニー(Robert Chesney)教授と、メリーランド大学(University of Maryland)のダニエレ・シトロン(Danielle Citron)教授だ。

だが、AIと安全保障問題を専門とするシンクタンク、新米国安全保障センター(CNAS)の上級研究員、ポール・シャーラー(Paul Scharre)氏は、これからの選挙では対立候補を陥れたり、実際の映像をうそであると人々に思いこませたりするために、ディープフェイク動画が活用されることはほぼ防げないと指摘する。

見た目に信用できそうなフェイク動画が拡散すれば、「人々は自分が信じたい方、自分が求めている主張に合った方を選ぶことになる。これはひどく気がかりだ」とシャーラーは話す。